同時具有Transformers和U-Net的優點,性能優於AttnUNet、V-Net等網絡,代碼剛剛開源!(按這樣搞,TransVNet、TransYOLO應該也快來了,手動狗頭)

注1:文末附【Transformer】和【醫療影像】交流羣

注2:整理不易,歡迎點贊,支持分享!

TransUNet: Transformers Make Strong Encoders for Medical Image Segmentation

作者單位:JHU, 電子科大, 斯坦福大學等

代碼: Beckschen/TransUNet

論文: https://arxiv.org/abs/2102.04306

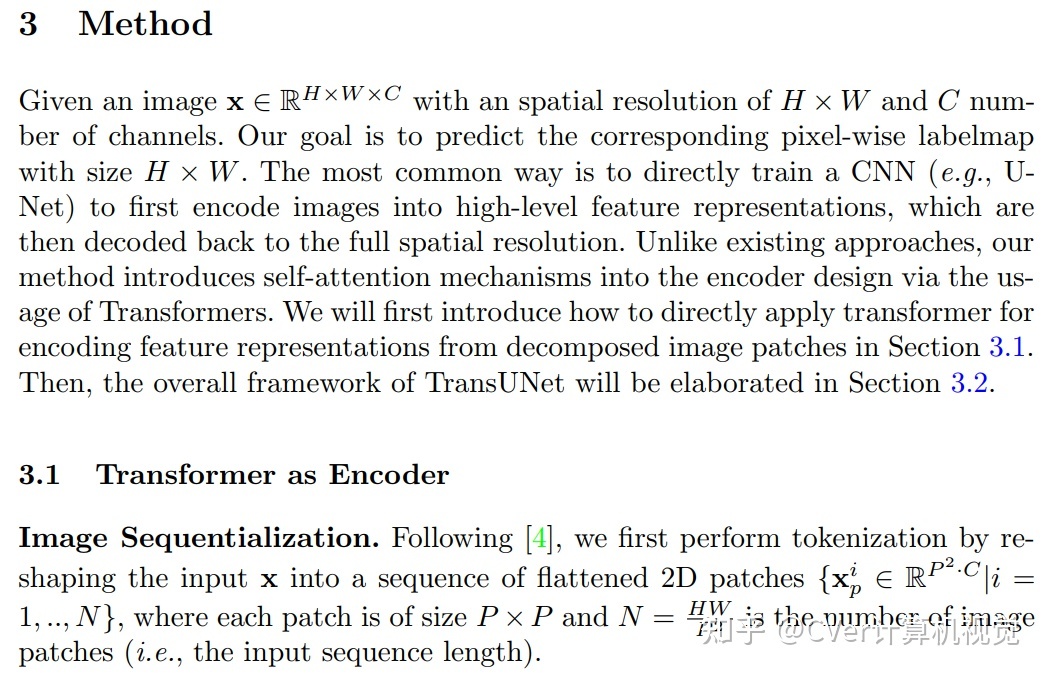

醫學圖像分割是開發醫療保健系統(尤其是疾病診斷和治療計劃)的必要先決條件。在各種醫學圖像分割任務中,U形架構(也稱爲U-Net)已成爲事實上的標準,並取得了巨大的成功。但是,由於卷積運算的固有局部性,U-Net通常在明確建模遠程依賴關係方面顯示出侷限性。

設計用於序列到序列預測的transformer已經成爲具有先天性全局自注意力機制的替代體系結構,但由於low-level細節不足,可能導致定位能力受到限制。

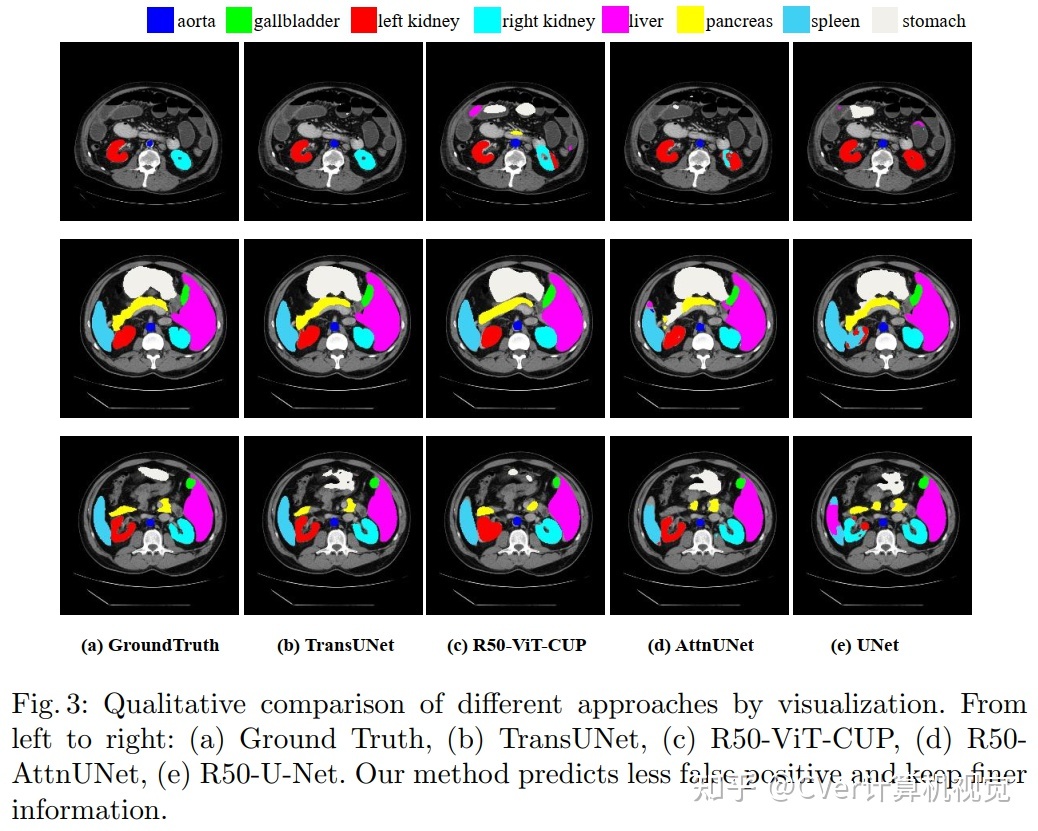

在本文中,我們提出了TransUNet,它同時具有Transformers和U-Net的優點,是醫學圖像分割的強大替代方案。

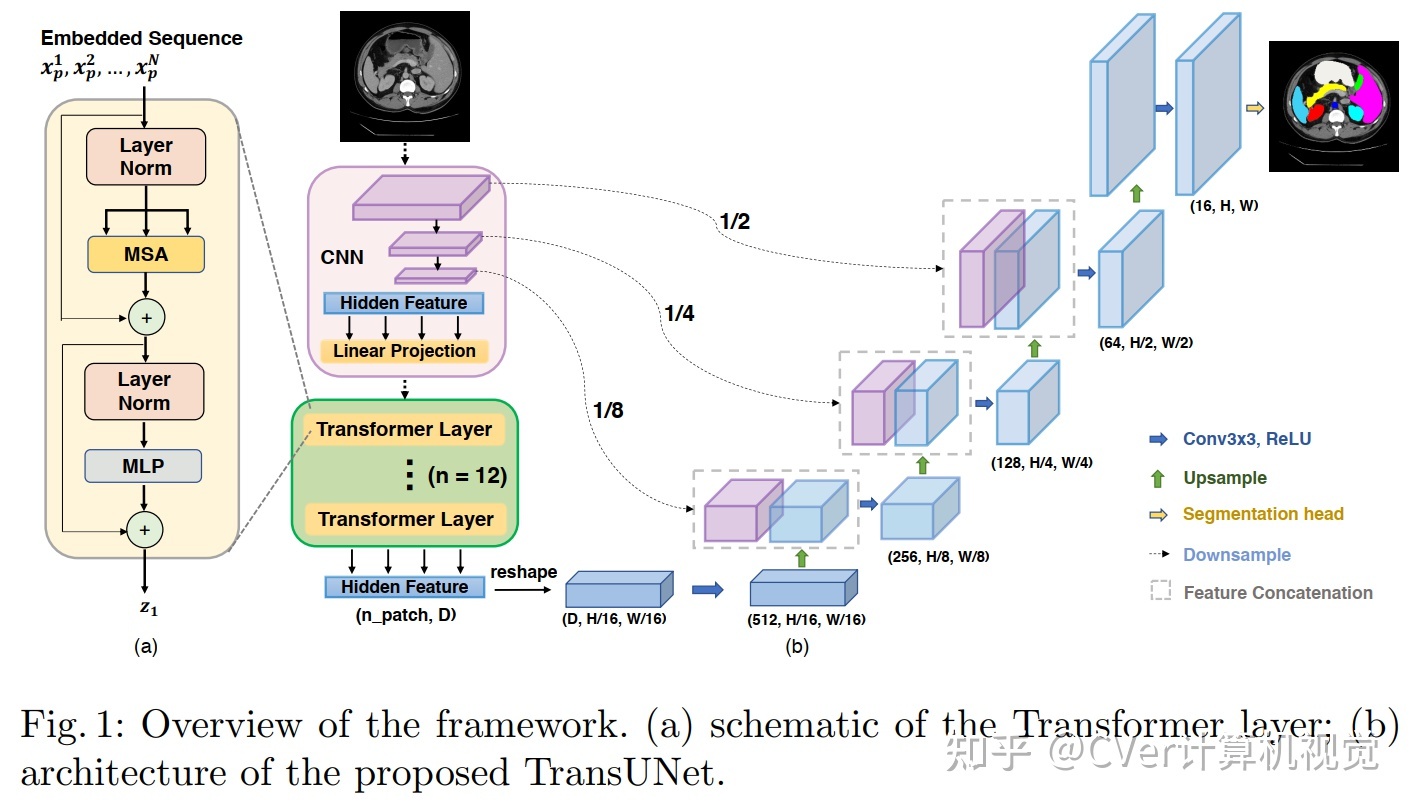

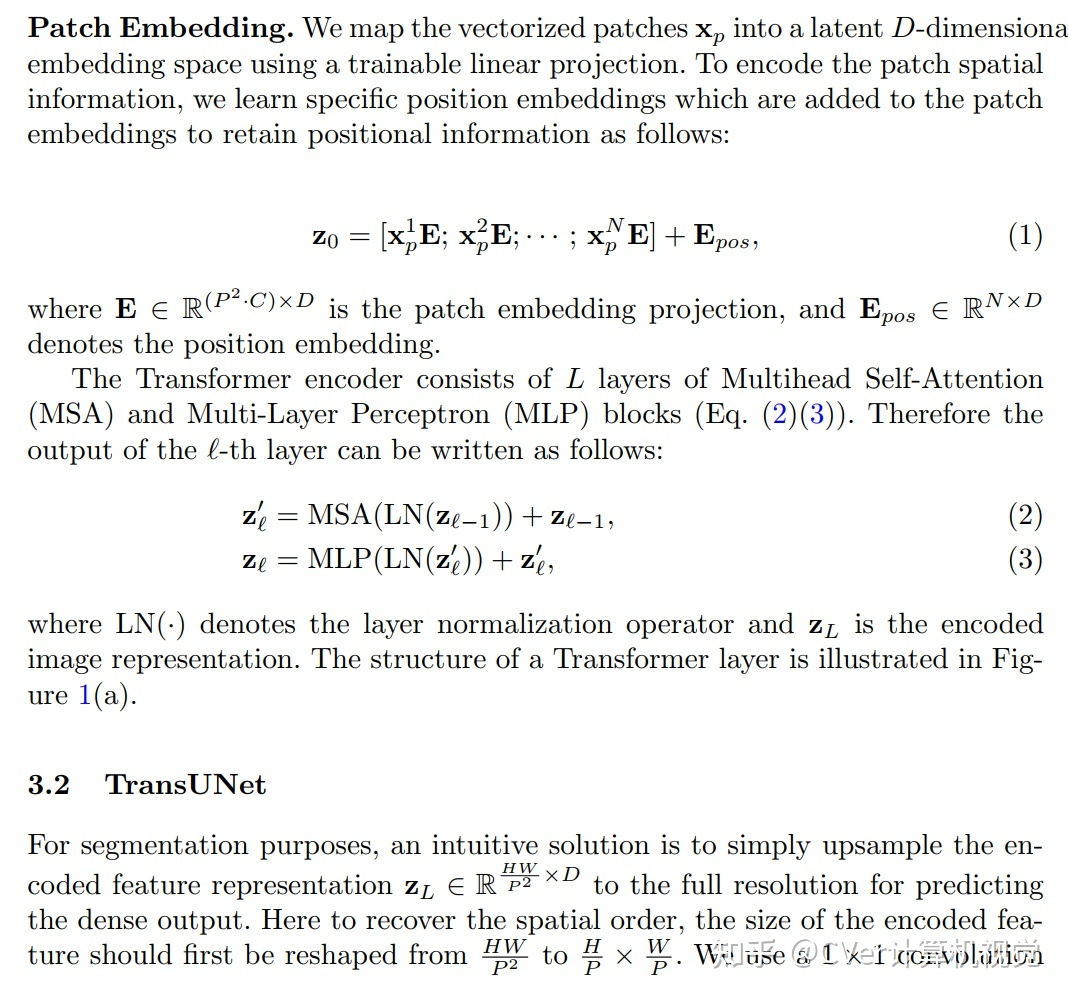

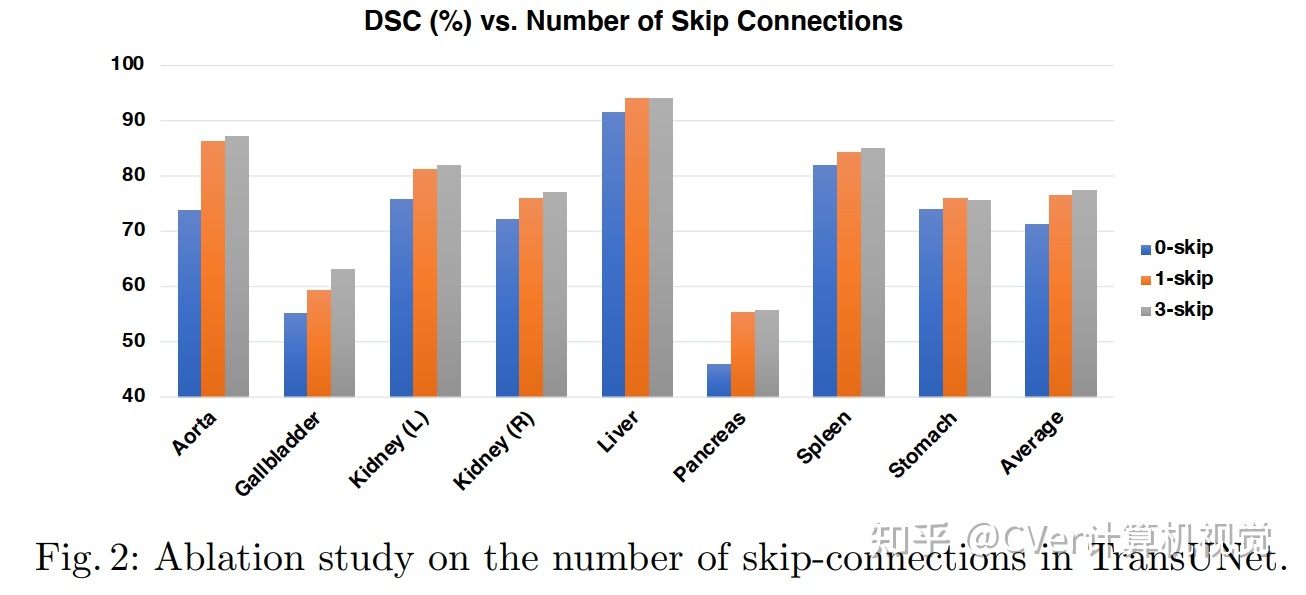

一方面,Transformer將來自卷積神經網絡(CNN)特徵圖的標記化圖像塊編碼爲提取全局上下文的輸入序列。另一方面,解碼器對編碼的特徵進行上採樣,然後將其與高分辨率的CNN特徵圖組合以實現精確的定位。

我們認爲,藉助U-Net的組合,通過恢復局部的空間信息,可以將Transformers用作醫學圖像分割任務的強大編碼器。

算法細節,建議去看原文

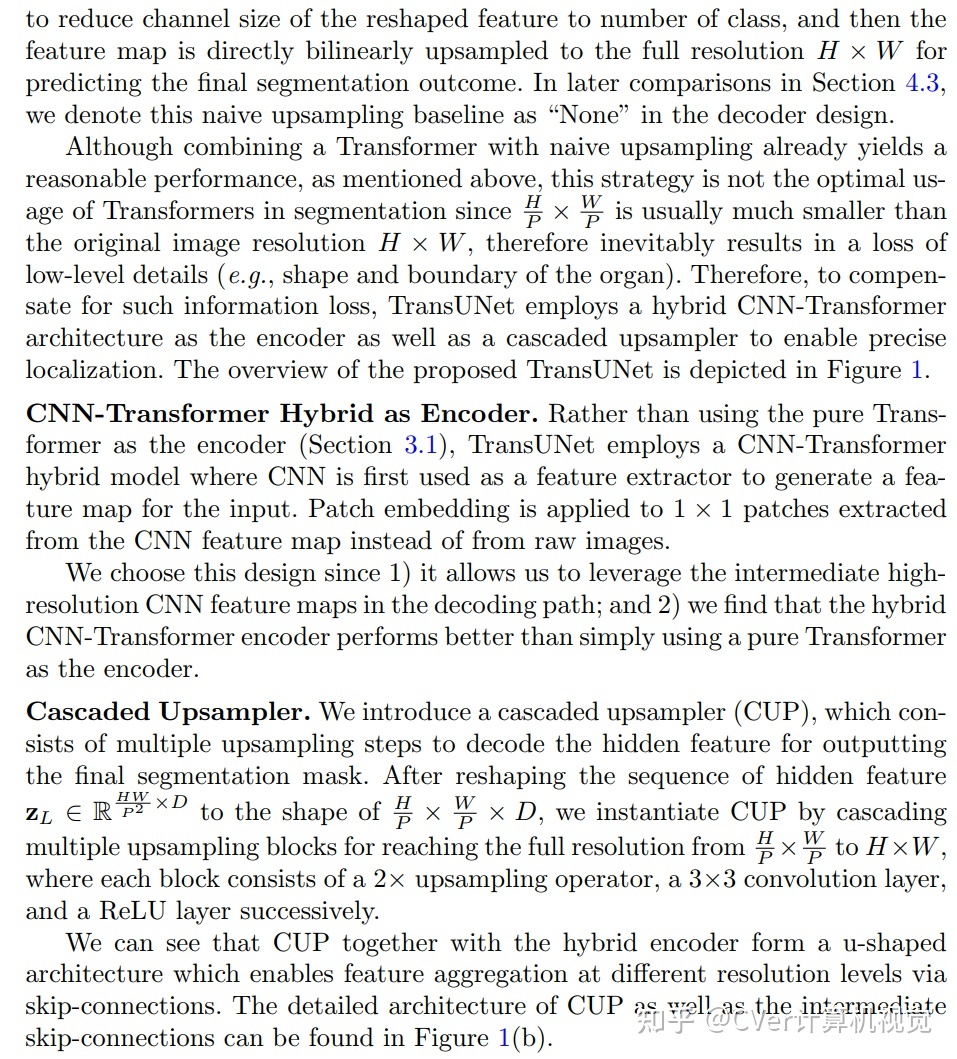

實驗結果

TransUNet在各種醫療應用(包括多器官分割和心臟分割)上均比各種競爭方法具有更高的性能。

CVer-Transformer交流羣

建了CVer-Transformer交流羣!想要進Transformer學習交流羣的同學,可以直接加微信號:CVer6666。加的時候備註一下:Transformer+學校+暱稱,即可。然後就可以拉你進羣了。

強烈推薦大家關注CVer知乎賬號和CVer微信公衆號,可以快速瞭解到最新優質的CV論文。

CVer-醫療影像交流羣

已建立CVer-醫療影像微信交流羣!想要進醫療影像學習交流羣的同學,可以直接加微信號:CVer9999。加的時候備註一下:醫療影像+學校+暱稱,即可。然後就可以拉你進羣了。

強烈推薦大家關注CVer知乎賬號和CVer微信公衆號,可以快速瞭解到最新優質的CV論文。

推薦閱讀

TransReID:首個基於Transformer的目標Re-ID

泛化神器!李沐等人提出兩種正則化技術:在CV和NLP均有大幅度提升

中國成都舉辦!ACM MM 2021 Call for Papers

效果遠超Transformer!AAAI 2021最佳論文Informer:最強最快的序列預測神器

DeepMind重新設計高性能ResNet!無需激活歸一化層

VisualSparta:首個基於Transformer的大規模文本到圖像檢索

南京大學提出SA-Net:深度卷積神經網絡的Shuffle注意力

CV待解決問題!華中科大提出OVIS:遮擋視頻實例分割(數據集+代碼)

T2T-ViT:在ImageNet上從頭訓練視覺Transformer

84.7%!BoTNet:視覺識別的Bottleneck Transformers

沒有卷積!CPTR:用於圖像描述的全Transformer網絡

北郵提出PCA-Net:用於細粒度視覺分類的漸進式協同注意力網絡

SSTVOS:基於稀疏時空Transformers的視頻目標分割網絡

攻下SLAM!用於無監督視覺里程錶的Transformer引導幾何模型

沒有自然圖像的預訓練 | ACCV 2020 最佳論文提名獎

基於深度學習的行人重識別(Re-ID)綜述:全面調研(2015-2020)

Focal-EIOU Loss:用於精確邊界框迴歸的高效IOU損失

曠視提出Momentum^2 Teacher:用於自監督學習的具有動量統計的動量老師

醫學圖像語義分割最佳方法的全面比較:U-Net和U-Net++

漲點神器!SoftPool:一種新的池化方法,帶你起飛,代碼已開源!

漲點神器!IC-Conv:具有高效空洞搜索的Inception卷積