用GAN(生成對抗網絡)製作卡通人物形象的研究,相信大家已見過不少。

但這一次新出爐的AniGAN,可以讓你指定任意畫風!

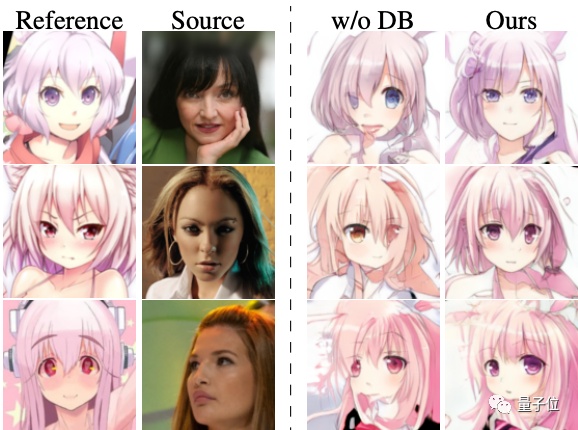

只需一張真實人物照片,加上一張你喜歡的畫師作品做爲參考,就能在保留原照片髮型、五官等形狀特徵的同時,遷移成相應的畫風。

拿來做頭像是不是很棒?

又雙叒叕一款GAN?這次更強!

AniGAN團隊認爲,之前的二次元人物生成算法有兩大問題。

要麼不能很好模仿參考圖的畫風,要麼會過於強調保留原始照片的形狀,卻並不適合二次元人物的風格,造成不符合審美的扭曲與瑕疵。

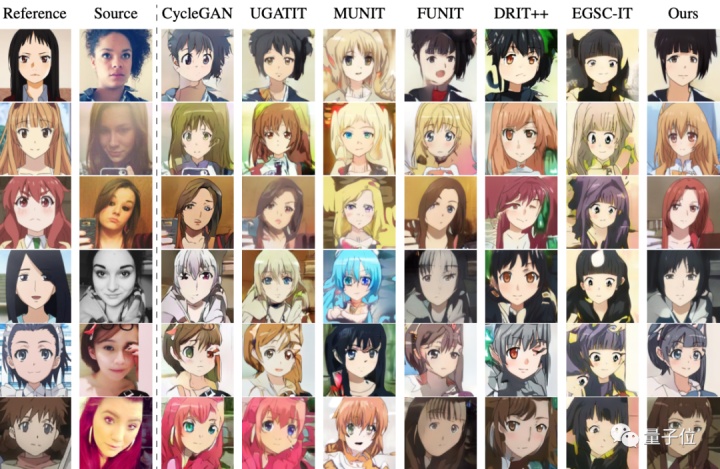

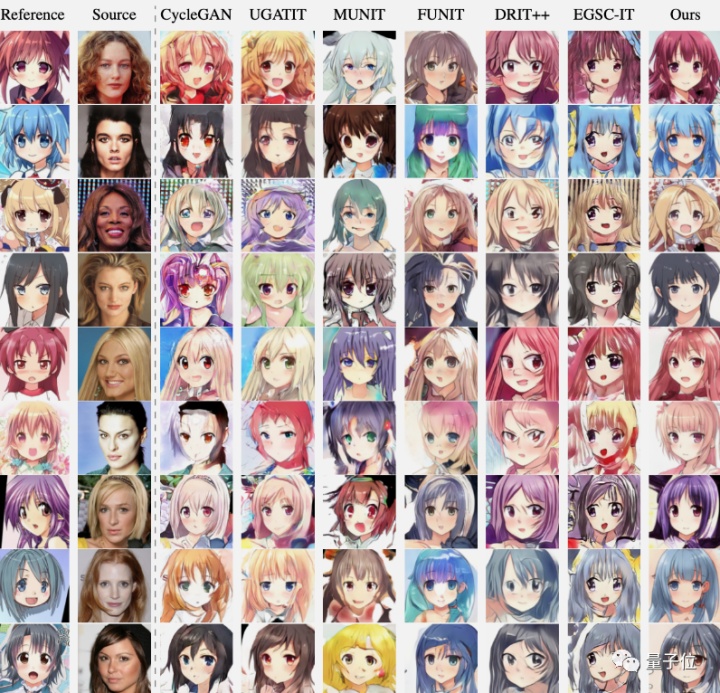

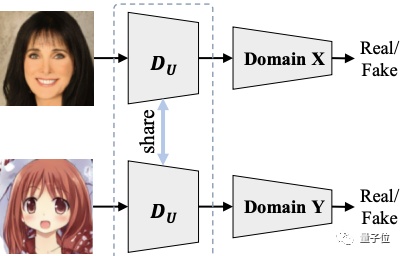

通過對比可以看出,AniGAN生成的結果在模仿參考圖顏色、材質,以及將原始特徵轉換成適合二次元方面都更出色。

下圖使用了更大的數據集,包含更多樣的色彩、線條、材質、髮型及五官特徵。

新的生成器架構

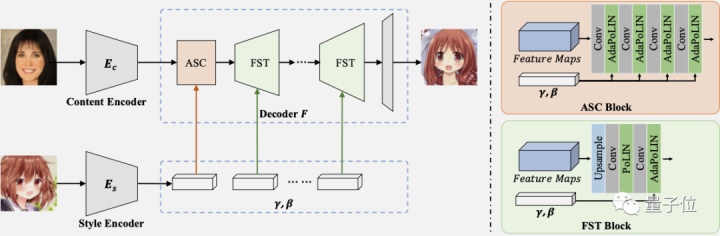

爲了在轉換形狀特徵的同時進行風格遷移,AniGAN團隊提出了新的生成器架構。

不同於以往使用殘差塊(Residual Blocks)在生成器的瓶頸層注入風格信息的方法。

AniGAN提出了自適應堆棧卷積塊 (Adaptive Stack Convolutional Block)和細粒度風格轉移塊( Fine-grained Style Transfer Block),以下簡稱爲ASC塊和FST塊。

ASC塊由卷積層、激活層和歸一化層組成。

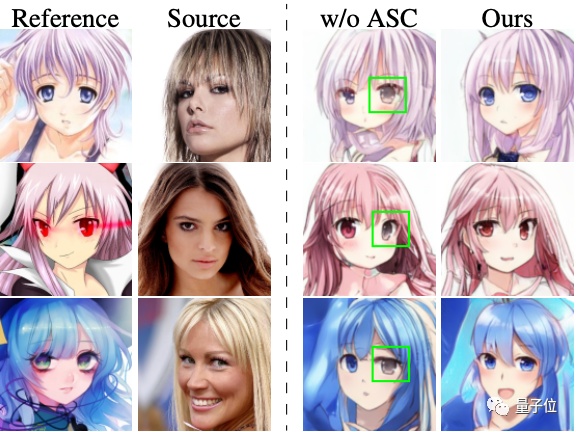

在以往使用殘差塊時,可能會忽略一些風格信息,如在下面例子中將右眼都錯誤地生成爲棕色。

FST塊由上採樣層,卷積層和歸一化層組成。

風格數據會在上採樣層之後而不是瓶頸層注入,負責把局部形狀特徵也處理成一種風格數據,並轉換成對應的二次元形狀。

去掉FST塊的情況下,生成圖像的面部特徵並不適應二次元風格。

兩種新的歸一化函數

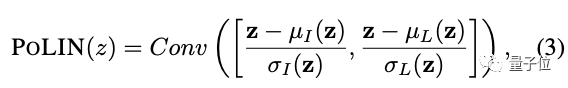

以往的AdaLIN歸一化函數會將實例歸一化(IN)和層歸一化(LN)按channel結合在一起,而忽略了channel間的相互關係。因此不能勝任遷移風格同時轉換特徵的任務。

AniGAN團隊提出了點狀層實例歸一化(point-wise layer instance normalization)和適應性點狀層實例歸一化( adaptive point-wise layer instance normalization ),以下簡稱PoLIN和AdaPoLIN。

PoLIN和AdaPoLIN會將所有channel的IN與LN結合在一起。

從左至右爲(a)參考圖像,(b)原始照片,(c)-(f)爲去掉PoLin或AdaPolin的各種組合的消融實驗,(g)爲正式效果

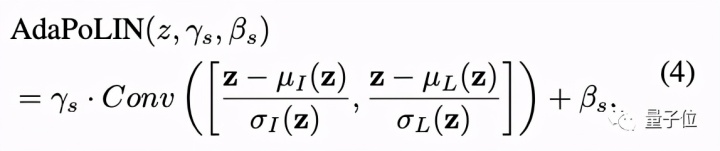

雙分支鑑別器(Double-branch Discriminator)

二次元人臉與真實人臉既有很大不同,又都是關於人臉。在研究中稱作領域X和領域Y。

雙分支鑑別器不僅可以通過卷積層的兩個分支處理特定領域的數據分佈,還可以處理跨領域共享的數據分佈。

雙分支鑑別器使生成的二次元人臉減少瑕疵,更加賞心悅目。

另外,該鑑別器也可以在後續研究中輕鬆擴展成多分支鑑別器(Multi-Branch Discriminator)。

圖像質量遠超前輩

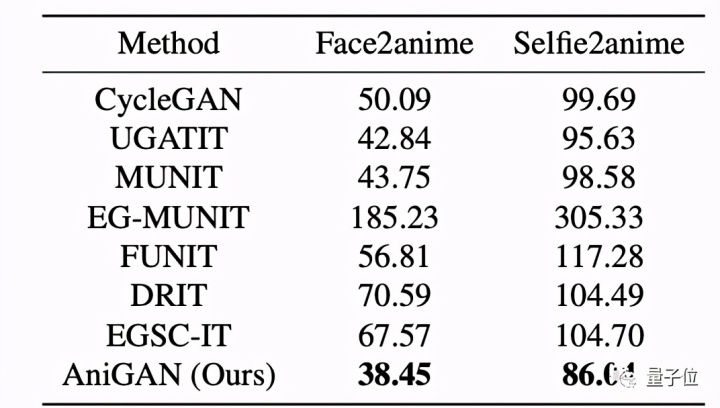

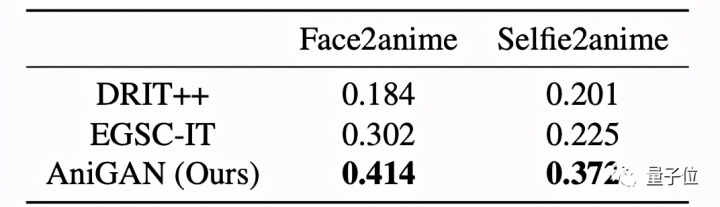

研究團隊使用了Frechet Inception Distance指標來評估生成圖像的質量,數值越低代表生成圖像越接近參考的二次元圖像。

並使用Learned Perceptual Image Patch Similarity來評估生成圖像之間的風格差異性,數值越高代表多個生成圖像之間越多樣。

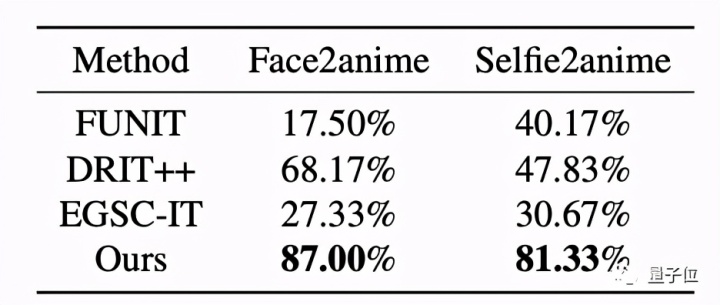

另外還選取了20位20-35歲的測試者進行A/B測試,詢問他們不同算法生成的圖像中哪張最符合真實照片的特徵以及參考圖像的風格,統計結果也是AniGAN得分最高。

作者團隊

本論文第一作者李冰,2016年中國科學院博士畢業,現在阿卜杜拉國王科技大學可視計算中心做博士後研究員。

團隊其他成員分別來自字節跳動、中國臺灣國立清華大學與深圳大學。

參考鏈接:

[1]https://arxiv.org/abs/2102.12593

—完—

@量子位 · 追蹤AI技術和產品新動態