via pixabay

按:本文是由來自谷歌語音團隊的科學家 Tara N. Sainath 和來自谷歌大腦團隊的科學家 Yonghui Wu 共同撰寫的,文中簡單介紹了最新論文《State-of-the-art Speech Recognition With Sequence-to-Sequence Models》的主要思想與取得的成果以及 Listen-Attend-Spell(LAS) 的端到端體系結構。我們根據原文進行了編譯。

提升語音識別的端到端模型

在谷歌各式各樣的語音搜索應用中,都是基於傳統的自動語音識別(Automatic speech recognition, ASR)系統實現的。傳統的 ASR 系統由聲學模型(Acoustic model, AM)、發音模型(Pronunciation model, PM)和語言模型(Language model, LM)組成,所有這些系統都是分開單獨進行訓練的並且通常還針對各自不同的數據集進行了單獨的手工設計[1]。聲學模型採用了聲學特徵,用於預測一組子字單元(Subword units),它們通常是上下文無關或者上下文相關的音素。然後通過手動設計的詞庫(也即 PM)將由聲學模型預測產生的一系列音素映射到對應的單詞。最終,由語言模型將概率賦予單詞序列。但是對這三個模型分開進行單獨訓練會增加訓練的複雜度,並且獨立訓練的效果不如將模型聯合訓練的效果好。在過去的幾年裏,開發端到端(End-to-end)的系統越來越受到學者們的歡迎,而這些端到端系統試圖將這些獨立的組件作爲一個單一系統進行聯合訓練。雖然在文獻[2, 3]中這些端到端模型已經展示出了頗爲驚豔的結果,但是這種端到端的方法是否可以被提升到趕上甚至超越最先進的傳統方法卻還仍然是一個未知數。

今天我們非常高興能夠與大家分享《State-of-the-art Speech Recognition With Sequence-to-Sequence Models》[4],它介紹了一種超越傳統生產系統[1]性能的全新端到端模型。論文中展示了,我們的端到端系統取得了 5.6% 的單詞錯誤率(Word error rate, WER),相比於強大的傳統系統(6.7% WER)取得了 16% 的提升。此外,這個用於輸出初始單詞假設的端到端模型,由於沒有獨立的發音模型和語言模型,因此比傳統模型小了 18 倍。

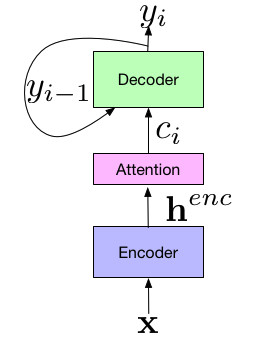

我們的系統建立在 Listen-Attend-Spell(LAS) 的端到端體系結構的基礎上,該體系結構最先由[2]提出。LAS 架構由三個組件構成。首先是聽者編碼器組件(Listener encoder component),聽者編碼器與標準的聲學模型相類似,它採用輸入語音信號 x 的時頻表示,並使用一組神經網絡將輸入映射到更高級的特徵表示 henc。然後聽者編碼器的輸出被輸入到第二個組件——參與者(Attender),參與者組件使用 henc 來學習輸入特徵 x 與預測的子字單元 {yn, ... y0} 之間的對應關係,其中每個子字通常是一個字素或者字片(Wordpiece)。最終,注意力模塊(Attention module)的輸出將被輸入第三個組件——拼字者(Speller,例如,解碼器),拼字者組件類似於語言模型,它將輸出一組假設詞語的概率分佈。

LAS 端到端模型組件圖

LAS 模型的所有組件都是被當做一個單一端到端神經網絡模型進行聯合訓練,這一點與傳統系統的分開訓練不同,同時也讓訓練過程變得更加簡單。此外,由於 LAS 模型完完全全採用神經網絡模型,所以它不需要手動設計額外的組件(例如,有限狀態轉換器、詞庫和文本標準化模塊)。最後,與傳統模型不同的是,訓練端到端模型不需要來自單獨訓練系統生成的決策樹或者時間對準的引導程序,並且可以訓練給定的文本副本(Text transcripts)對和相應的聲學對。

在論文[4]中,我們介紹了各種新穎的改進結構,包括改進了傳遞給解碼器的注意力向量(Attention vectors)和採用更長的子字單元(例如,字片)進行訓練。此外,我們還介紹了大量的訓練優化改進,包括使用最小誤碼率訓練[5]策略。這些結構和優化上的改進正是爲何我們的模型相比起傳統模型能夠取得 16% WER 提升的原因。

這項研究的另一項令人興奮的潛在應用是多方言(Multi-dialect)和多語言(Multi-lingual)系統,其中優化單個神經網絡的簡便性使得這樣的模型非常具有吸引力。在這裏所有方言或者語言都可以結合起來訓練一個神經網絡,而不需要爲每種方言或者語言去單獨設置聲學模型、發音模型和語言模型。我們發現這些模型在 7 個英語方言[6]和 9 個印度語[7]上取得了很好的效果,並且同時還超越了在每個方言或者語言上進行單獨訓練的模型。

雖然我們爲最終的結果感到非常高興,但是我們的工作卻還遠遠沒有完成。當前,這些模型還不能實時處理語音[8, 9, 10],而做到實時處理這一點對於語音搜索等對延遲敏感的應用而言卻是剛需。另外在採用真實生產數據進行評估時,這些模型的表現依然不夠有效。此外我們的端到端模型是在 22000 個音頻文本對話中進行學習的,而傳統系統通常是在大型語料庫上進行訓練的。另外,我們提出的模型不能爲罕見的詞彙學習正確的拼寫,例如那些由手工設計的發音模型來實現的專有名詞。我們當前正在努力攻克這些挑戰。

引用

[1] G. Pundak and T. N. Sainath, 「Lower Frame Rate Neural Network Acoustic Models ," in Proc. Interspeech, 2016.

[2] W. Chan, N. Jaitly, Q. V. Le, and O. Vinyals, 「Listen, attend and spell ,」 CoRR, vol. abs/1508.01211, 2015

[3] R. Prabhavalkar, K. Rao, T. N. Sainath, B. Li, L. Johnson, and N. Jaitly, 「A Comparison of Sequence-to-sequence Models for Speech Recognition ,」 in Proc. Interspeech, 2017.

[4] C.C. Chiu, T.N. Sainath, Y. Wu, R. Prabhavalkar, P. Nguyen, Z. Chen, A. Kannan, R.J. Weiss, K. Rao, K. Gonina, N. Jaitly, B. Li, J. Chorowski and M. Bacchiani, 「State-of-the-art Speech Recognition With Sequence-to-Sequence Models ,」 submitted to ICASSP 2018.

[5] R. Prabhavalkar, T.N. Sainath, Y. Wu, P. Nguyen, Z. Chen, C.C. Chiu and A. Kannan, 「Minimum Word Error Rate Training for Attention-based Sequence-to-Sequence Models ,」 submitted to ICASSP 2018.

[6] B. Li, T.N. Sainath, K. Sim, M. Bacchiani, E. Weinstein, P. Nguyen, Z. Chen, Y. Wu and K. Rao, 「Multi-Dialect Speech Recognition With a Single Sequence-to-Sequence Model」 submitted to ICASSP 2018.

[7] S. Toshniwal, T.N. Sainath, R.J. Weiss, B. Li, P. Moreno, E. Weinstein and K. Rao, 「End-to-End Multilingual Speech Recognition using Encoder-Decoder Models」, submitted to ICASSP 2018.

[8] T.N. Sainath, C.C. Chiu, R. Prabhavalkar, A. Kannan, Y. Wu, P. Nguyen and Z. Chen, 「Improving the Performance of Online Neural Transducer Models 」, submitted to ICASSP 2018.

[9] C.C. Chiu* and C. Raffel*, 「Monotonic Chunkwise Attention ,」 submitted to ICLR 2018.

[10] D. Lawson*, C.C. Chiu*, G. Tucker*, C. Raffel, K. Swersky, N. Jaitly. 「Learning Hard Alignments with Variational Inference」, submitted to ICASSP 2018.

[11] T.N. Sainath, R. Prabhavalkar, S. Kumar, S. Lee, A. Kannan, D. Rybach, V. Schogol, P. Nguyen, B. Li, Y. Wu, Z. Chen and C.C. Chiu, 「No Need for a Lexicon? Evaluating the Value of the Pronunciation Lexica in End-to-End Models ,」 submitted to ICASSP 2018.

[12] A. Kannan, Y. Wu, P. Nguyen, T.N. Sainath, Z. Chen and R. Prabhavalkar. 「An Analysis of Incorporating an External Language Model into a Sequence-to-Sequence Model,」 submitted to ICASSP 2018.

Via : Improving End-to-End Models For Speech Recognition ,