自從 GAN 出世以來,頂尖的生成模型都採用了這種框架。然而從去年的 Glow 到最近的 EBM,很多研究者都嘗試探索不同的生成框架。在這篇論文中,OpenAI 的研究者提出一種能高效訓練基於能量模型(EBM)的方法,它能獲得媲美 GAN 的效果。

值得注意的是,一作 Yilun Du 還是 MIT 的大四本科生,他從 15 年大一開始就發過 ECCV 16、NIPS 18 等多個大會和 Workshop 的論文,加上這篇論文一共 8 篇。Yilun Du 的工作經驗也非常多,他在 Facebook 做過軟件工程實習生,目前在 OpenAI 多智能體強化學習團隊做研究。Yilun Du 的簡歷表示,他在 MIT 的 GPA 爲 5.0/5.0,這基本上屬於學神的領域了。

在 Yilun Du 等研究者的這篇論文中,OpenAI 在基於能量模型(EBM)的穩定和可擴展訓練方面已經取得了進展,從而獲得了比現有模型更好的樣本質量和泛化能力。EBM 中的生成過程花費更多的算力來不斷精煉(refinement)其生成結果,這樣做可以在低 temperature 條件下生成與 GAN 媲美的樣本,同時還具有基於似然模型的模式覆蓋率保證。他們希望這些發現能促進對這類模型的進一步研究。

生成建模是一種與觀察數據(如圖像或文本)有關的任務,它需要學習建模潛在的數據分佈。完成這項任務可以讓模型理解數據中的高級特徵,併合成看起來真實的樣例。生成模型在自然語言、機器人學和計算機視覺方面已經有廣泛的應用。

基於能量的模型通過爲每個輸入數據點分配一個非歸一化的概率標量(或「能量」)來表示數據上的概率分佈。這提供了實用的模型靈活性——在給定輸入的情況下,任何輸出實數的模型都可以用作能量模型。然而難點在於從這些模型中採樣,它也導致了 EBM 模型不能像 GAN 或 VAE 那樣快速訓練。

條件 ImageNet 32x32 模型樣本。

爲了從 EBM 中生成樣本,Open AI 使用了一種基於 Langevin dynamics 的迭代精煉過程。通俗地說,這包含了在能量函數上執行噪聲梯度下降,以達到低能量配置(更多細節見論文)。與 GAN、VAE 和基於 Flow 的模型不同,這種方法不需要一個顯式的神經網絡來生成樣本,也就是說,樣本的生成過程是隱式的。EBM 和迭代精煉的結合有以下好處:

自適應計算時間:可以長時間執行序列精煉,以生成優質、多元的樣本,也可以在較短時間內生成粗糙、單一的樣本。已知在有限的時間內,這一過程可以從能量模型中生成真實的樣本。

不受生成網絡限制:在 VAE 和基於 Flow 的模型中,生成器都必須學習如何從連續空間映射到到包含不同數據模型的不連續空間,這需要模型有很大的擬合能力,而且可能無法完成學習。相比之下,EBM 可以輕鬆學習在互斥區域分配低能量。

內置語義合成:由於每個模型都表示一個非歸一化的概率分佈,因此可以通過專家模型或其他分層模型自然地組合模型。

生成

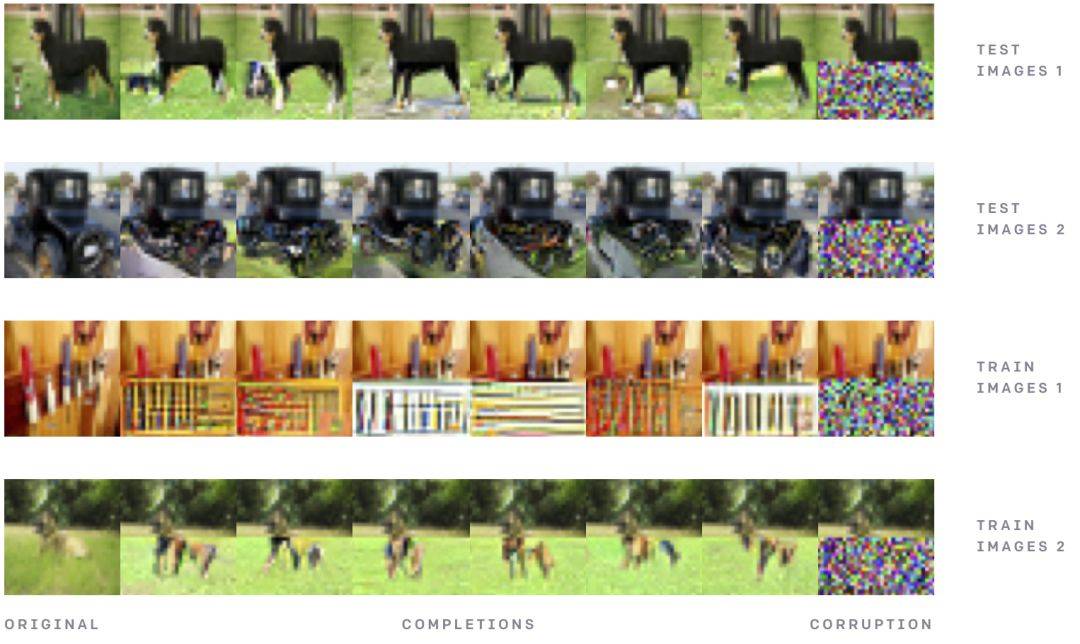

作者發現基於能量的模型能夠生成高質量、高數量的高清圖片,特別是在測試階段長時間運行精煉流程。通過在單張圖像上執行迭代優化,研究者可以自動補全圖像,並把圖像從一種類別(卡車)改變爲另一種類別(青蛙)。

在條件 ImageNet 模型上執行圖像補全,該模型展示了圖像修補中的多樣性。注意輸入來自於測試分佈,並非模型樣本,它表示測試數據的覆蓋範圍。

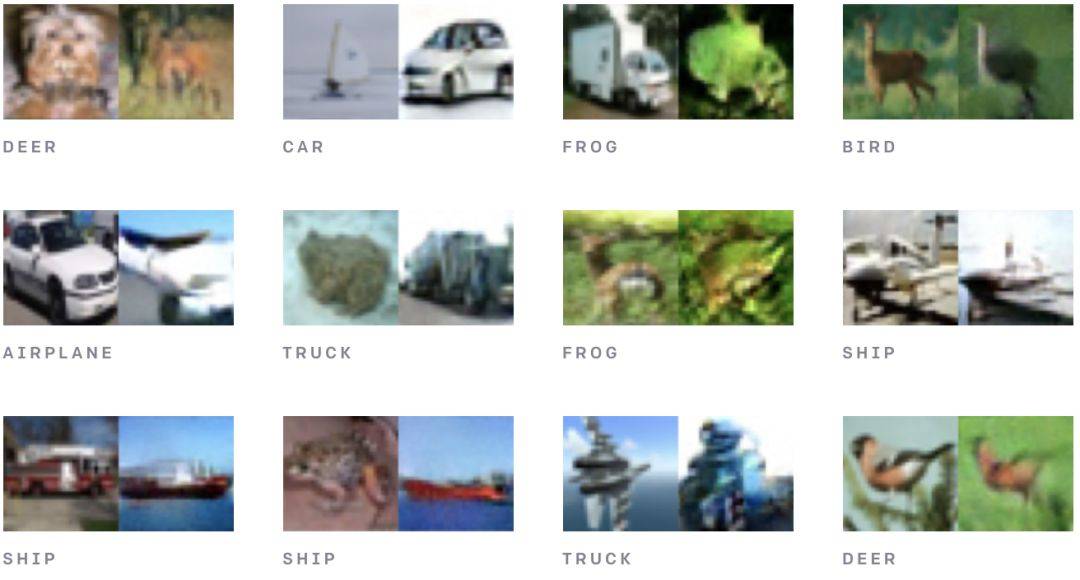

在條件模型上的跨類別隱式採樣,模型以特定類別爲條件,但用一張來自獨立類別的圖像做初始化。

除了生成圖像,作者發現基於能量的模型在大量時間步驟上能夠生成穩定的機器人動態軌跡。雖然前饋模型不能做均值預測,EBM 卻能夠生成一系列不同的可能性。

自上而下查統一啓動狀態下無條件生成的機器臂操作軌跡。FC 網絡預測到了一個不動的手臂,然而 EBM 能夠生成可執行的不同軌跡。

泛化性

研究者還在幾種不同的分佈外(out-of-distribution)數據集上測試了 EBM 的分類效果,他們發現基於能量的模型要比其它似然模型有更好的效果,例如流模型或自迴歸模型等。作者同樣使用條件 EBM 測試了分類任務,並發現分類結果對於對抗擾動具有很好的泛化性。儘管他們的模型從未爲分類任務訓練過,但比那些專門爲對抗擾動進行分類訓練的模型效果還要好。

研究經驗

研究者發現了很多有意思的觀察結果,但目前並不是太確定這些結果是不是正確,不過這些經驗可能對後續研究有一些幫助。

研究者發現原版 HMC 用於 EBM 訓練非常困難,因爲訓練過程中的最佳步長和 leapfrog 模擬數量差別很大,不過應用適應性 HMC 可能是比較有意思的擴展。

研究者發現執行能量函數的集成訓練會很有幫助,即採樣和評估都在集成上進行,但並不值得爲這些提升而增加模型複雜性。

研究者在添加梯度罰項時並不能取得很好的效果,可能是因爲梯度罰項會損失模型的能力與採樣效果。

更多的模型細節與實驗細節可以查閱該研究論文。

論文:Implicit Generation and Generalization in Energy-Based Models

摘要:因爲在似然函數建模中的簡潔與通用,基於能量的模型(EBM)吸引了很多研究者的關注,但這種模型不太容易訓練。我們提出了一種技術以擴展連續神經網絡上基於 MCMC 的 EBM 訓練,展示了它在高維數據上的效果,例如 ImageNet 32x32、ImageNet 128x128、CIFAR-10 和機械臂軌跡。在這些數據集中,EBM 比其它似然模型能顯著生成更好的樣本,它能在覆蓋數據所有模式的同時得到和 GAN 相媲美的性能。

我們強調隱式生成的獨特能力,例如能量的合成性、圖像修復重建和圖像補全等。最後,我們展示了 EBM 能泛化地非常好,並能實現當前最優的分佈外(out-of-distribution)分類效果。此外,EBM 還能展現出對抗性魯棒的分類、連貫地長期預測軌跡變化,並生成 zero-shot 的模型合成。