採樣問題是數據科學中的常見問題,對此,WalmartLabs 的數據科學家 Rahul Agarwal 分享了數據科學家需要了解的 5 種採樣方法,我編譯整理如下。

數據科學實際上是就是研究算法。

我每天都在努力學習許多算法,所以我想列出一些最常見和最常用的算法。

本文介紹了在處理數據時可以使用的一些最常見的採樣技術。

簡單隨機抽樣

假設您要選擇一個羣體的子集,其中該子集的每個成員被選擇的概率都相等。

下面我們從一個數據集中選擇 100 個採樣點。

sample_df = df.sample(100)

分層採樣

假設我們需要估計選舉中每個候選人的平均票數。現假設該國有 3 個城鎮:

A 鎮有 100 萬工人,

B 鎮有 200 萬工人,以及

C 鎮有 300 萬退休人員。

我們可以選擇在整個人口中隨機抽取一個 60 大小的樣本,但在這些城鎮中,隨機樣本可能不太平衡,因此會產生偏差,導致估計誤差很大。

相反,如果我們選擇從 A、B 和 C 鎮分別抽取 10、20 和 30 個隨機樣本,那麼我們可以在總樣本大小相同的情況下,產生較小的估計誤差。

使用 python 可以很容易地做到這一點:

from sklearn.model_selection import train_test_split

X_train, X_test, y_train, y_test = train_test_split(X, y,

stratify=y,

test_size=0.25)

水塘採樣

我喜歡這個問題陳述:

假設您有一個項目流,它長度較大且未知以至於我們只能迭代一次。

創建一個算法,從這個流中隨機選擇一個項目,這樣每個項目都有相同的可能被選中。

我們怎麼能做到這一點?

假設我們必須從無限大的流中抽取 5 個對象,且每個元素被選中的概率都相等。

import randomdef generator(max):

number = 1

while number < max:

number += 1

yield number# Create as stream generator

stream = generator(10000)# Doing Reservoir Sampling from the stream

k=5

reservoir = []

for i, element in enumerate(stream):

if i+1<= k:

reservoir.append(element)

else:

probability = k/(i+1)

if random.random() < probability:

# Select item in stream and remove one of the k items already selected

reservoir[random.choice(range(0,k))] = elementprint(reservoir)

------------------------------------

[1369, 4108, 9986, 828, 5589]

從數學上可以證明,在樣本中,流中每個元素被選中的概率相同。這是爲什麼呢?

當涉及到數學問題時,從一個小問題開始思考總是有幫助的。

所以,讓我們考慮一個只有 3 個項目的流,我們必須保留其中 2 個。

當我們看到第一個項目,我們把它放在清單上,因爲我們的水塘有空間。在我們看到第二個項目時,我們把它放在列表中,因爲我們的水塘還是有空間。

現在我們看到第三個項目。這裏是事情開始變得有趣的地方。我們有 2/3 的概率將第三個項目放在清單中。

現在讓我們看看第一個項目被選中的概率:

移除第一個項目的概率是項目 3 被選中的概率乘以項目 1 被隨機選爲水塘中 2 個要素的替代候選的概率。這個概率是:

2/3*1/2 = 1/3

因此,選擇項目 1 的概率爲:

1–1/3=2/3

我們可以對第二個項目使用完全相同的參數,並且可以將其擴展到多個項目。

因此,每個項目被選中的概率相同:2/3 或者用一般的公式表示爲 K/N

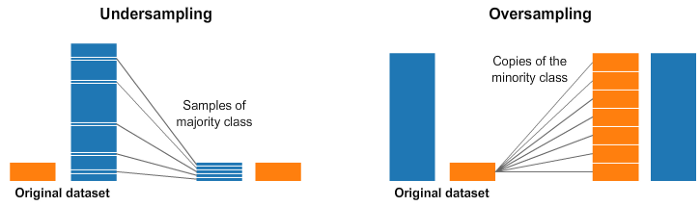

隨機欠採樣和過採樣

我們經常會遇到不平衡的數據集。

一種廣泛採用的處理高度不平衡數據集的技術稱爲重採樣。它包括從多數類(欠採樣)中刪除樣本或向少數類(過採樣)中添加更多示例。

讓我們先創建一些不平衡數據示例。

from sklearn.datasets import make_classificationX, y = make_classification(

n_classes=2, class_sep=1.5, weights=[0.9, 0.1],

n_informative=3, n_redundant=1, flip_y=0,

n_features=20, n_clusters_per_class=1,

n_samples=100, random_state=10

)X = pd.DataFrame(X)

X['target'] = y

我們現在可以使用以下方法進行隨機過採樣和欠採樣:

num_0 = len(X[X['target']==0])

num_1 = len(X[X['target']==1])

print(num_0,num_1)# random undersampleundersampled_data = pd.concat([ X[X['target']==0].sample(num_1) , X[X['target']==1] ])

print(len(undersampled_data))# random oversampleoversampled_data = pd.concat([ X[X['target']==0] , X[X['target']==1].sample(num_0, replace=True) ])

print(len(oversampled_data))------------------------------------------------------------

OUTPUT:

90 10

20

180

使用 imbalanced-learn 進行欠採樣和過採樣

imbalanced-learn(imblearn)是一個用於解決不平衡數據集問題的 python 包,它提供了多種方法來進行欠採樣和過採樣。

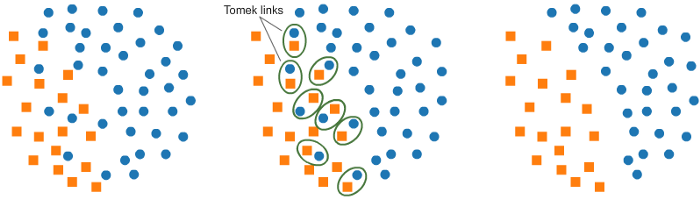

a. 使用 Tomek Links 進行欠採樣:

imbalanced-learn 提供的一種方法叫做 Tomek Links。Tomek Links 是鄰近的兩個相反類的例子。

在這個算法中,我們最終從 Tomek Links 中刪除了大多數元素,這爲分類器提供了一個更好的決策邊界。

from imblearn.under_sampling import TomekLinks

tl = TomekLinks(return_indices=True, ratio='majority')

X_tl, y_tl, id_tl = tl.fit_sample(X, y)

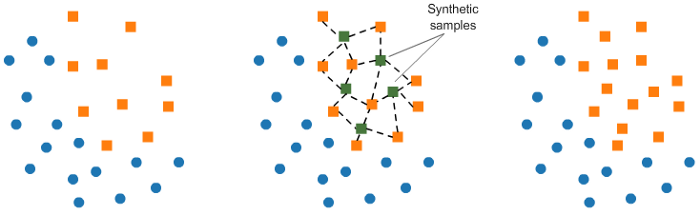

b. 使用 SMOTE 進行過採樣:

在 SMOE(Synthetic Minority Oversampling Technique)中,我們在現有元素附近合併少數類的元素。

from imblearn.over_sampling import SMOTE

smote = SMOTE(ratio='minority')

X_sm, y_sm = smote.fit_sample(X, y)

imbLearn 包中還有許多其他方法,可以用於欠採樣(Cluster Centroids, NearMiss 等)和過採樣(ADASYN 和 bSMOTE)。

結論

算法是數據科學的生命線。

抽樣是數據科學中的一個重要課題,但我們實際上並沒有討論得足夠多。

有時,一個好的抽樣策略會大大推進項目的進展。錯誤的抽樣策略可能會給我們帶來錯誤的結果。因此,在選擇抽樣策略時應該小心。

如果你想了解更多有關數據科學的知識,我想把 Andrew Ng 的這門優秀課程推薦給你,這個課程是我入門數據科學的法寶,你一定要去看看。