選自Mozilla

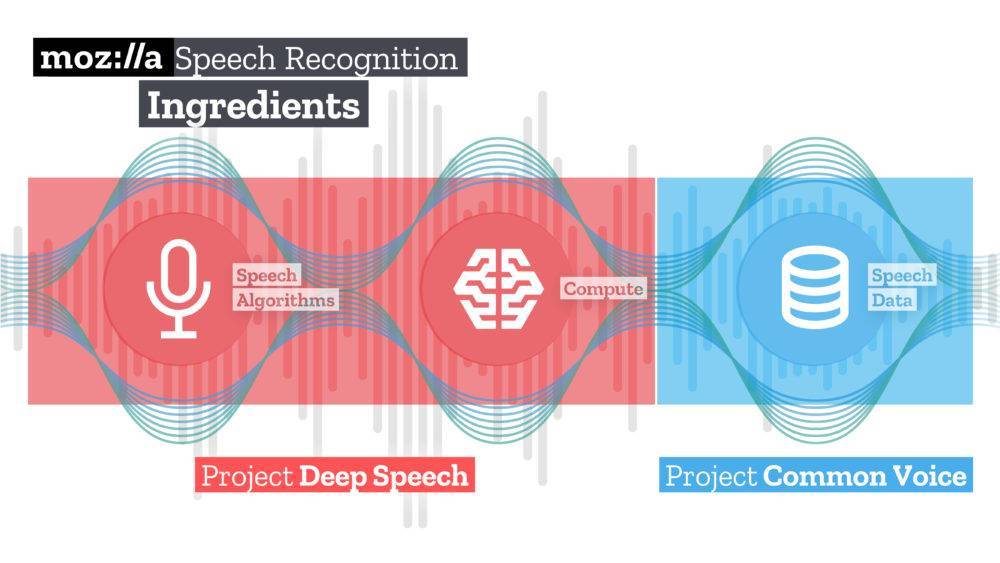

Mozilla 對語音識別的潛能抱有很大期望,但這一領域目前仍然存在對創新的明顯阻礙,這些挑戰激發這家公司啓動了 DeepSpeech 項目和 Common Voice 項目。近日,他們首次發佈了開源語音識別模型,其擁有很高的識別準確率。與此同時,這家公司還發布了世界上第二大的公開語音數據集,該數據集由全球將近 20000 人所貢獻。

開源語音識別模型:https://hacks.mozilla.org/2017/11/a-journey-to-10-word-error-rate/

公開語音數據集:https://medium.com/mozilla-open-innovation/sharing-our-common-

DeepSpeech:一個開源的語音到文本的轉換引擎,可以達到用戶期待的高性能

目前市場上只有少量可用的商業性質的語音識別服務,且被少數幾個大公司佔據。這限制了初創公司、研究者,甚至那些希望在產品和服務中引入語音功能的大型公司的用戶選擇和可選特性。

這也是 Mozilla 啓動並將 DeepSpeech 作爲開源項目的初衷。和一羣志同道合的開發者、公司和研究者一起,該公司通過應用複雜的機器學習技術,並開發多項新技術建立了一個語音到文本的轉換引擎,它在 LibrSpeech 的 test-clean 數據集上僅有 6.5% 的詞錯率。

DeepSpeech 項目鏈接:https://github.com/mozilla/DeepSpeech

Mozilla 首次發佈的 DeepSpeech 產品中包括了預構建的 Python 包、NodeJS 包和一個命令行二進制,從而使開發者可以立刻使用並進行語音識別實驗。

Common Voice:建立世界上種類最多的公開語音數據集,以及開發最優化的語音訓練技術

商業化服務如此少的一個原因是數據的缺乏。初創公司、研究者或任何其他想要建立具備語音功能的技術需要高質量的轉錄語音數據用於訓練機器學習算法。目前他們只能獲得相當有限的數據集。

爲了解決這個問題,Mozilla 在今年七月份啓動了 Common Voice 項目(https://voice.mozilla.org/)。該項目的目標是使人們能輕鬆地將他們的語音數據貢獻到一個公開數據集上,從而建立一個所有人都可用於訓練新的具備語音功能應用的語音數據集。

本次,Mozilla 公佈了貢獻數據集的第一部分:大約 400,000 份錄音,500 個小時時長。所有人都可以在這裏下載:https://voice.mozilla.org/data

Mozilla 認爲,該數據集最重要的貢獻是向我們展示了整個世界的樣貌——它擁有超過 20000 人的貢獻者,新的數據集反映了全世界的語音多樣性。通常現有的語音識別服務無法理解不同的方言,且很多服務對男性的識別效果高於對女性的識別效果,這是由訓練數據帶來的偏差。Mozilla 期望貢獻者的數量規模和不同的背景、方言可以爲我們創建一個全球化的代表性數據集,進而開發出更具包容性的技術。

雖然目前主要是英文數據,但是未來 Common Voice 將支持對多種語言的貢獻,這個計劃將從 2018 年上半年開始。

最後,Mozilla 還蒐集了下載所有目前常用的其它大型語音數據集的鏈接,進一步緩解數據集匱乏問題。

原文鏈接:https://blog.mozilla.org/blog/2017/11/29/announcing-the-initial-release-of-mozillas-open-source-speech-recognition-model-and-voice-dataset/